Las alucinaciones de la IA: los peligros académicos

Introducción

En distintos espacios de reflexión académica se ha discutido ampliamente sobre las virtudes de los modelos de lenguaje generativo para apoyar la labor docente, no solo en Matemáticas, sino también en otras áreas del currículo educativo. Particularmente, la IA generativa puede fungir como un asesor o copiloto de la acción docente, con la capacidad de reducir barreras que históricamente han limitado el ejercicio profesional del profesorado. Entre sus ventajas destacan su bajo costo relativo, la diversidad de opciones de acceso, la compatibilidad con múltiples dispositivos, donde el teléfono móvil juega un papel estratégico en contextos de recursos limitados, su naturaleza multilingüe y su capacidad para conectar al docente con fuentes de información de alcance global.

No obstante, también es necesario considerar los riesgos asociados a estas herramientas. Uno de los más relevantes es la tendencia a aceptar sus respuestas de manera acrítica, fenómeno vinculado tanto al sesgo de automatización como a la autoridad algorítmica (Parasuraman & Manzey, 2010), es decir, la predisposición a confiar en sistemas automatizados debido a su apariencia técnica y coherencia discursiva. En este contexto, el término MathWashing, popularizado por Fred Benenson (2016), resulta útil como categoría interpretativa para describir cómo la estructura técnica o matemática del discurso puede conferir una apariencia de objetividad y veracidad a contenidos que no necesariamente han sido verificados.

Este trabajo analiza el fenómeno de las alucinaciones en sistemas de IA generativa y argumenta que la vigilancia cognitiva constituye una competencia fundamental para docentes e investigadores en la actualidad.

1. El docente aumentado y sus riesgos

El término “docente aumentado” comparte raíces con desarrollos recientes en la literatura sobre inteligencia artificial en educación (Muñoz et al., 2024; ProFuturo, 2025). Se refiere a un profesional que incorpora la IA como apoyo a su práctica pedagógica, sin delegar su responsabilidad profesional. La IA puede potenciar la planificación didáctica, el diseño de actividades y los procesos de evaluación, en coherencia con el currículo educativo, sus fundamentos teóricos y los principios éticos de la profesión docente.

En América Latina, esta integración puede contribuir con el docente a enfrentar la denominada “trampa de la doble exigencia” que corresponde a la tensión estructural que enfrenta el docente cuando se le demanda simultáneamente el cumplimiento de un currículo en entornos escolares precarizados, con déficits de recursos didácticos, infraestructura tecnológica y conectividad, agravados por una carga burocrática que consume tiempo y energía. En Costa Rica, esta situación ha sido documentada en informes del Estado de la Educación (PEN-CONARE, 2023, 2025).

Sin embargo, la literatura reciente advierte que el uso no crítico de estas herramientas puede comprometer la calidad del aprendizaje. En particular, las alucinaciones en modelos de lenguaje, definidas como la generación de información plausible pero incorrecta o no fundamentada (Huang et al., 2024), pueden introducir errores conceptuales difíciles de detectar en contextos educativos. Diversos estudios señalan que este problema puede afectar la integridad académica, inducir aprendizajes erróneos y debilitar el pensamiento crítico si no se implementan estrategias de verificación (Danyaro et al., 2025).

2. Cuando la forma oculta el error

Las respuestas generadas por la IA suelen producir un fuerte efecto de confianza en el receptor. Su coherencia, fluidez y estructura técnica generan una percepción de rigor que puede ser interpretada erróneamente como evidencia de veracidad. Este fenómeno es al que puede entenderse como una forma de autoridad algorítmica, donde la legitimidad del contenido se deriva de la apariencia del sistema que lo produce. En este contexto describe cómo la forma técnica del discurso puede sustituir la validación epistemológica del contenido.

Desde el punto de vista técnico, los modelos de lenguaje generan texto a partir de patrones estadísticos, sin un mecanismo explícito y garantizado de verificación de la verdad. Por ello, pueden producir explicaciones detalladas sobre conceptos inexistentes, incluyendo ejemplos y referencias ficticias. Este problema no es meramente técnico, sino también cognitivo y epistemológico. Como señalan Bender et al. (2021) y Ji et al. (2023), los modelos de lenguaje no operan sobre una base de comprensión semántica del mundo, sino mediante la predicción estadística de secuencias lingüísticas. En consecuencia, pueden producir afirmaciones incorrectas con una confianza aparente que resulta difícil de detectar.

La literatura especializada coincide en que las alucinaciones no son errores marginales, sino una limitación estructural de estos sistemas, lo que representa uno de los principales desafíos para su uso confiable (Tonmoy et al., 2024).

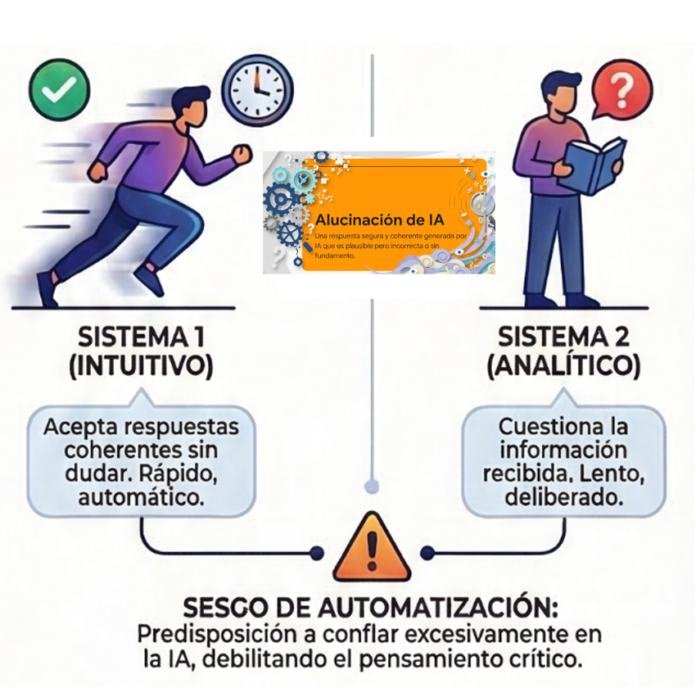

3. Sistema 1 y Sistema 2: la base cognitiva de la vigilancia crítica

El psicólogo Daniel Kahneman (2011) distingue entre dos modos de pensamiento: el Sistema 1 (rápido, intuitivo y automático) y el Sistema 2 (lento, deliberado y analítico). Ante respuestas bien formuladas por la IA, los usuarios tienden a activar el Sistema 1, aceptando la información sin cuestionamiento. Este comportamiento se relaciona directamente con el sesgo de automatización, que describe la tendencia a confiar excesivamente en sistemas automatizados.

Este fenómeno no es exclusivo de la IA, pero se ve amplificado por su capacidad de generar respuestas coherentes, técnicas y aparentemente fundamentadas en cuestión de segundos. En el ámbito educativo, este riesgo se traduce en una posible disminución del pensamiento crítico y la autonomía intelectual, especialmente cuando los usuarios desarrollan dependencia de estas herramientas (Danyaro et al., 2025).

Por ello, la competencia clave para un educador consiste en activar el Sistema 2: cuestionar, contrastar y verificar la información antes de utilizarla. Esta práctica constituye lo que puede denominarse vigilancia cognitiva, entendida como una actitud deliberada de evaluación crítica frente a la información generada por sistemas automatizados.

4. Evidencia concreta: pruebas documentadas

Este fenómeno no es meramente hipotético. En el ámbito jurídico, el caso Mata v. Avianca (2023) evidenció cómo se presentaron precedentes inexistentes generados por sistemas de inteligencia artificial, lo que derivó en sanciones judiciales. Desde entonces, se han documentado numerosos incidentes similares en distintos países, lo que sugiere un patrón emergente de errores asociados al uso no crítico de estos sistemas (American Bar Association, 2023; Charlotin, 2025).

Aunque la evidencia notoria, con fines académicos para ilustrar a los lectores de este Blog se realizaron algunas pruebas deliberadas con dos plataformas de IA ampliamente utilizadas. Se formularon preguntas sobre teorías matemáticas inexistentes y figuras ficticias. En todos los casos, los sistemas generaron respuestas elaboradas, con explicaciones coherentes y referencias inexistentes, sin advertir el error. Solo al ser confrontados, reconocieron la alucinación (para más detalles se recomiendo leer la siguiente entrega en el Blog).

Este comportamiento coincide con hallazgos en la literatura, que señalan que las alucinaciones pueden afectar la precisión del conocimiento disciplinar cuando no son detectadas en contextos educativos (Lane, 2025). Asimismo, casos recientes en el ámbito profesional han evidenciado las consecuencias del uso no crítico de estas herramientas, reforzando la necesidad de verificar toda información generada por IA antes de su uso formal.

5. Reflexión final: la IA como asesor, no como oráculo

El problema no radica en la inteligencia artificial en sí misma, sino en su uso acrítico. Los sistemas de IA generan texto plausible, no conocimiento verificado. Un docente aumentado no delega sus decisiones pedagógicas en la IA, sino que la utiliza para ampliar su capacidad profesional, manteniendo activo su juicio crítico y sus principios éticos.

Además, un error con el uso de una alucinación de la IA no recae en la herramienta ni en la empresa que la desarrolla, sino en quien la utiliza. Está ampliamente documentado que los sistemas de lenguaje generativo pueden producir información falsa (Ji et al., 2023; Farquhar et al., 2024). En el ámbito jurídico, el caso conocido como Mata v. Avianca (S.D.N.Y., 2023) evidenció cómo se presentaron precedentes inexistentes generados por sistemas de inteligencia artificial, lo que derivó en sanciones judiciales. Asimismo, en Zhang v. Chen (2024 BCSC 285), el Tribunal Superior de Columbia Británica determinó que la presentación de citas ficticias generadas por IA vulnera el deber de diligencia profesional. Estos hechos refuerzan un principio elemental: todo contenido generado por IA debe ser verificado antes de su uso en contextos formales; no hacerlo no es un simple descuido técnico, sino una omisión profesional. Claridad, fluidez y coherencia no son sinónimos de veracidad. Reconocer esta distinción es fundamental en el contexto educativo contemporáneo.

6. Continuación

En una próxima entrega se analizarán ejemplos concretos de interacciones con IA que evidencian estos riesgos, con el fin de profundizar en estrategias de uso crítico.

Nota metodológica

Los intercambios con sistemas de IA que se citan en este artículo y en el documento complementario fueron realizados deliberadamente por el autor con fines de investigación educativa, el 14 de marzo de 2026, utilizando las plataformas AtlasGPT y Gemini. El objetivo no es evaluar ni desacreditar productos comerciales específicos, sino ilustrar un fenómeno ampliamente documentado en la literatura sobre inteligencia artificial. Ninguna persona real es aludida en los nombres ficticios generados por los sistemas.

Lista de referencias

American Bar Association. (2023). ABA formal opinion 512: Generative artificial intelligence tools. Standing Committee on Ethics and Professional Responsibility. https://www.americanbar.org/groups/professional_responsibility/publications/ethics-opinions/

Bender, E. M., Gebru, T., McMillan-Major, A., & Shmitchell, S. (2021). On the dangers of stochastic parrots: Can language models be too big? En Proceedings of the 2021 ACM Conference on Fairness, Accountability, and Transparency (pp. 610–623). ACM. https://doi.org/10.1145/3442188.3445922

Benenson, F. (2016, mayo). Mathwashing, Facebook and the zeitgeist of data worship. Technical.ly Brooklyn. https://technical.ly/uncategorized/fred-benenson-mathwashing-facebook-data-worship/

Charlotin, D. (2025). AI hallucination cases database. HEC Paris Smart Law Hub. https://www.damiencharlotin.com/hallucinations/

Danyaro, K. U., Abdullahi, S., Abdallah, A. S., & Chiroma, H. (2025). Hallucinations in large language models for education: Challenges and mitigation. International Journal of Teaching, Learning and Education, 4(6), 13–19. https://doi.org/10.22161/ijtle.4.6.2

Delikoura, I., Vosinakis, S., Giannakopoulos, G., & Koutsombogera, M. (2025). From superficial outputs to superficial learning: Risks of large language models in education. arXiv preprint arXiv:2503.10837. https://arxiv.org/abs/2503.10837

Farquhar, S., Kossen, J., Kuhn, L., & Gal, Y. (2024). Detecting hallucinations in large language models using semantic entropy. Nature, 630, 625–630. https://doi.org/10.1038/s41586-024-07421-0

Haidt, J. (2024). The anxious generation: How the great rewiring of childhood is causing an epidemic of mental illness. Penguin Press.

Huang, L., Yu, W., Ma, W., Zhong, W., Feng, Z., Wang, H., Chen, Q., Peng, W., Feng, X., Qin, B., & Liu, T. (2024). A survey on hallucination in large language models: Principles, taxonomy, challenges, and open questions. ACM Transactions on Information Systems, 43(1), 1–55. https://doi.org/10.1145/3703155

Ji, Z., Lee, N., Frieske, R., Yu, T., Su, D., Xu, Y., Ishii, E., Bang, Y., Chen, D., Dai, W., Chan, H. S., Madotto, A., & Fung, P. (2023). Survey of hallucination in natural language generation. ACM Computing Surveys, 55(12), 1–38. https://doi.org/10.1145/3571730

Kahneman, D. (2011). Thinking, fast and slow. Farrar, Straus and Giroux.

Lane, R. (2025). Mitigating generative AI hallucinations in geographical education. International Research in Geographical and Environmental Education. Publicación anticipada en línea. https://doi.org/10.1080/10382046.2025.2555185

Mata v. Avianca, Inc., 678 F. Supp. 3d 443 (S.D.N.Y. 2023).

Muñoz, J. L., Lorenzo, M., & Suñé, A. (Coords.). (2024). Inteligencia artificial en la microeducación. ODITE.

Parasuraman, R., & Manzey, D. H. (2010). Complacency and bias in human use of automation: An attentional integration. Human Factors, 52(3), 381–410. https://doi.org/10.1177/0018720810376055

Programa Estado de la Nación [PEN]. (2023). Noveno Informe Estado de la Educación. CONARE. https://estadonacion.or.cr/educacion/

Programa Estado de la Nación [PEN]. (2025). Décimo Informe Estado de la Educación. CONARE. https://estadonacion.or.cr/educacion/

ProFuturo. (2025). El docente aumentado: IA para amplificar las virtudes pedagógicas. Fundación Telefónica / Fundación La Caixa. https://profuturo.education/observatorio/tendencias/docente-aumentado/

Tonmoy, S. M. T. I., Zaman, S., Jain, V., Pal, A., Bhatt, C., & Devanand, A. (2024). A comprehensive survey of hallucination mitigation techniques in large language models. IEEE Access, 12, 32322–32357. https://doi.org/10.1109/ACCESS.2024.3370293

Zhang v. Chen, 2024 BCSC 285. Tribunal Superior de Columbia Británica. Canadá.